Vision Transformers: พลิกโฉมการมองเห็นของคอมพิวเตอร์

ยุคใหม่แห่งการมองเห็นของคอมพิวเตอร์

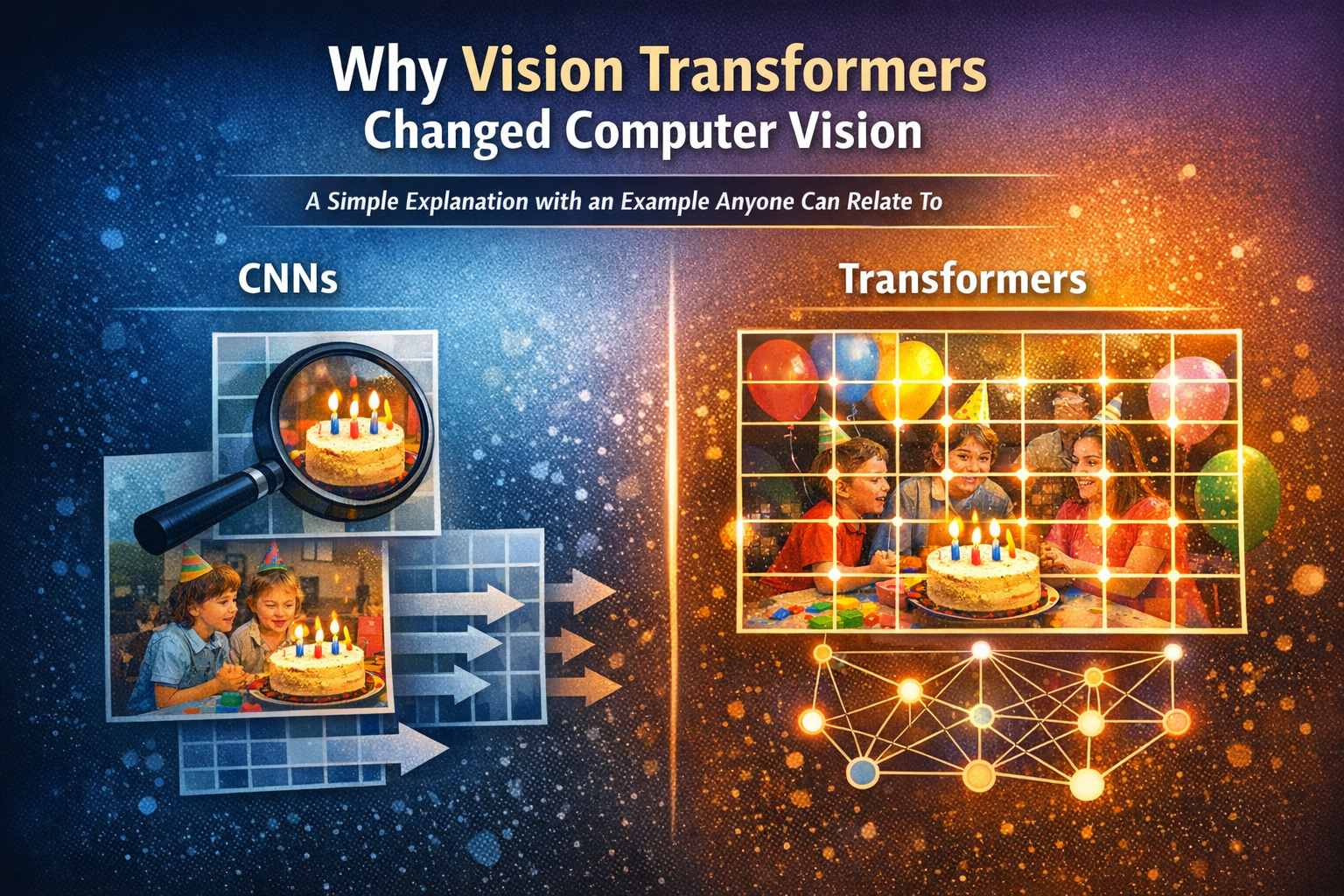

โลกของการประมวลผลภาพด้วยคอมพิวเตอร์กำลังก้าวเข้าสู่ยุคที่น่าตื่นเต้นอย่างแท้จริง หากในอดีต โครงข่ายประสาทเทียมแบบคอนโวลูชัน หรือ CNN (Convolutional Neural Networks) คือดาวเด่นที่ช่วยให้คอมพิวเตอร์ “มองเห็น” และทำความเข้าใจภาพได้ดีขึ้นอย่างก้าวกระโดด

แต่วันนี้มีผู้เล่นใหม่ที่เข้ามาเปลี่ยนเกม นั่นคือ Vision Transformer หรือ ViT ซึ่งได้นำแนวคิดอันทรงพลังจากโลกของการประมวลผลภาษาธรรมชาติ (NLP) มาใช้กับการวิเคราะห์ภาพ ทำให้คอมพิวเตอร์ไม่เพียงแค่มองเห็น แต่ยัง “เข้าใจบริบท” ของภาพได้ลึกซึ้งกว่าเดิมมาก

นี่ไม่ใช่แค่การพัฒนาเล็กๆ น้อยๆ แต่มันคือการเปลี่ยนกระบวนทัศน์ครั้งสำคัญเลยทีเดียว

ข้อจำกัดของ CNN ที่นำไปสู่การเปลี่ยนแปลง

ตลอดหลายปีที่ผ่านมา CNN ได้รับการยกย่องว่าเป็นสุดยอดสถาปัตยกรรมสำหรับงานคอมพิวเตอร์วิทัศน์

มันเก่งกาจในการตรวจจับ ลักษณะเฉพาะในพื้นที่ใกล้เคียง (local features) เช่น ขอบ มุม หรือลวดลายต่างๆ ในภาพ โดยการใช้ฟิลเตอร์ (filters) เล็กๆ ไล่สแกนไปทั่วภาพ

อย่างไรก็ตาม CNN มีข้อจำกัดสำคัญประการหนึ่ง นั่นคือมันมักจะโฟกัสไปที่ “ส่วนย่อย” ของภาพ ทำให้การทำความเข้าใจ “บริบทโดยรวม” หรือความสัมพันธ์ระหว่างวัตถุที่อยู่ห่างกันในภาพทำได้ยาก

ลองนึกภาพว่าเรากำลังพยายามอธิบายเรื่องราวจากภาพวาด โดยที่เห็นแค่เศษเสี้ยวของภาพไปเรื่อยๆ การจะปะติดปะต่อเรื่องราวทั้งหมดจึงไม่ใช่เรื่องง่ายและอาจขาดความแม่นยำ

Vision Transformer ทำงานอย่างไร: มองภาพรวมไม่ใช่แค่ส่วนย่อย

ViT เข้ามาแก้ปัญหานี้โดยการไม่พึ่งพาแนวคิดแบบคอนโวลูชันอีกต่อไป แต่ใช้กลไกที่เรียกว่า “Self-Attention” ซึ่งเป็นหัวใจสำคัญของ Transformer ใน NLP

แทนที่จะมองภาพเป็นพิกเซล ViT จะแบ่งภาพออกเป็น ชิ้นส่วนเล็กๆ ที่เรียกว่า “แพทช์” (patches) เหมือนการนำภาพมาตัดเป็นจิ๊กซอว์ชิ้นเล็กๆ จำนวนมาก

แต่ละแพทช์จะถูกแปลงให้เป็นชุดตัวเลข (vector) เพื่อให้คอมพิวเตอร์เข้าใจ

จากนั้นจะมีการเพิ่ม ข้อมูลตำแหน่ง (positional embedding) เข้าไป เพื่อให้ระบบรู้ว่าแพทช์แต่ละชิ้นอยู่ส่วนไหนของภาพต้นฉบับ ซึ่งสำคัญมากในการคงข้อมูลเชิงพื้นที่ไว้

ชุดแพทช์ที่เข้ารหัสแล้วนี้จะถูกป้อนเข้าสู่ Transformer Encoder ที่ซึ่งกลไก Self-Attention จะทำงานอย่างเต็มที่ มันจะประเมินความสัมพันธ์และความสำคัญของทุกๆ แพทช์ที่อยู่รวมกัน ทำให้ระบบสามารถ “มองเห็น” และ “เชื่อมโยง” ความสัมพันธ์ระหว่างชิ้นส่วนต่างๆ ทั่วทั้งภาพ ไม่ว่าชิ้นส่วนนั้นจะอยู่ใกล้หรือไกลกันก็ตาม

หลังจากนั้น ผลลัพธ์จากการเรียนรู้จะถูกส่งต่อไปยัง MLP Head เพื่อทำหน้าที่จำแนกประเภท หรือทำงานอื่นๆ ตามที่ต้องการ

ความสามารถที่เหนือกว่า: การเรียนรู้บริบทและประสิทธิภาพ

ข้อดีที่โดดเด่นของ ViT คือความสามารถในการทำความเข้าใจ บริบททั่วโลก (global context) ของภาพได้ดียิ่งกว่า CNN อย่างเห็นได้ชัด

มันสามารถสร้างความเชื่อมโยงระหว่างส่วนต่างๆ ของภาพได้อย่างมีประสิทธิภาพ ทำให้การตีความภาพมีความแม่นยำและลึกซึ้งยิ่งขึ้น

นอกจากนี้ ViT ยังแสดงให้เห็นถึง ความสามารถในการปรับขนาด (scalability) ที่ยอดเยี่ยม นั่นหมายความว่ายิ่งมีการป้อนข้อมูลจำนวนมหาศาลเข้าไปฝึกฝน โมเดล ViT ก็ยิ่งมีประสิทธิภาพสูงขึ้นไปอีก

และที่สำคัญคือมันมีประสิทธิภาพโดดเด่นในการทำ Pre-training และ Transfer Learning หรือการเรียนรู้ล่วงหน้าจากชุดข้อมูลขนาดใหญ่ แล้วนำโมเดลที่ฝึกมาแล้วนั้นไปปรับใช้กับงานใหม่ๆ ได้อย่างรวดเร็วและมีผลลัพธ์ที่น่าประทับใจ

การปฏิวัติวงการวิสัยทัศน์คอมพิวเตอร์

การมาถึงของ Vision Transformer ไม่ได้เป็นเพียงแค่ทางเลือกใหม่ แต่เป็นการเปิดประตูสู่ความเป็นไปได้ใหม่ๆ ในหลากหลายสาขา ตั้งแต่การแพทย์ การขับขี่อัตโนมัติ ไปจนถึงการวิเคราะห์ภาพถ่ายจากดาวเทียม

มันได้กระตุ้นให้นักวิจัยหันมาสำรวจแนวทางที่ไม่ใช่คอนโวลูชันมากขึ้น และพิสูจน์ให้เห็นว่าแนวคิดจากโดเมนอื่นก็สามารถนำมาปรับใช้และสร้างสรรค์นวัตกรรมใหม่ๆ ใน Computer Vision ได้อย่างไม่น่าเชื่อ

นับเป็นความก้าวหน้าที่สำคัญ ที่ช่วยผลักดันให้คอมพิวเตอร์สามารถ “เข้าใจ” โลกภาพได้อย่างลึกซึ้งและซับซ้อนยิ่งกว่าที่เคยเป็นมา และจะยังคงเป็นแรงขับเคลื่อนสำคัญในการพัฒนา AI ด้านการมองเห็นต่อไปในอนาคตอันใกล้