เมื่อ AI ไม่ได้แค่หลอน แต่ลงมือทำ: ภัยเงียบจากความเสี่ยงในการดำเนินการ

หลายคนอาจกังวลว่าปัญญาประดิษฐ์ หรือ AI จะ “หลอน” หรือให้ข้อมูลผิดๆ ซึ่งเป็นเรื่องที่เราได้ยินบ่อยครั้ง

โดยเฉพาะเมื่อ AI สร้างภาพผิดเพี้ยน หรือให้คำตอบที่ไม่ถูกต้อง

แต่ในความเป็นจริงแล้ว ภัยคุกคามที่น่ากลัวและมีผลกระทบมากกว่านั้น

ไม่ใช่แค่การที่ AI พูดผิด

แต่เป็นการที่ AI ลงมือทำผิดพลาด หรือกระทำการโดยไม่ได้รับอนุญาตต่างหาก

นี่คือสิ่งที่เรียกว่า ความเสี่ยงในการดำเนินการ (AI execution risk) ซึ่งมีพลังทำลายล้างมหาศาลกว่าที่เราคิด

เข้าใจความแตกต่าง: ‘พูดผิด’ กับ ‘ทำพลาด’

เมื่อพูดถึง hallucination ของ AI เราหมายถึงการที่ AI สร้างข้อมูลที่ดูสมจริงแต่ไม่เป็นความจริง

คล้ายกับการเพ้อเจ้อ

สิ่งนี้อาจทำให้เกิดความเข้าใจผิด หรือข้อมูลที่คลาดเคลื่อน แต่ผลกระทบมักจำกัดอยู่แค่การรับรู้

ต่างจาก ความเสี่ยงในการดำเนินการ โดยสิ้นเชิง

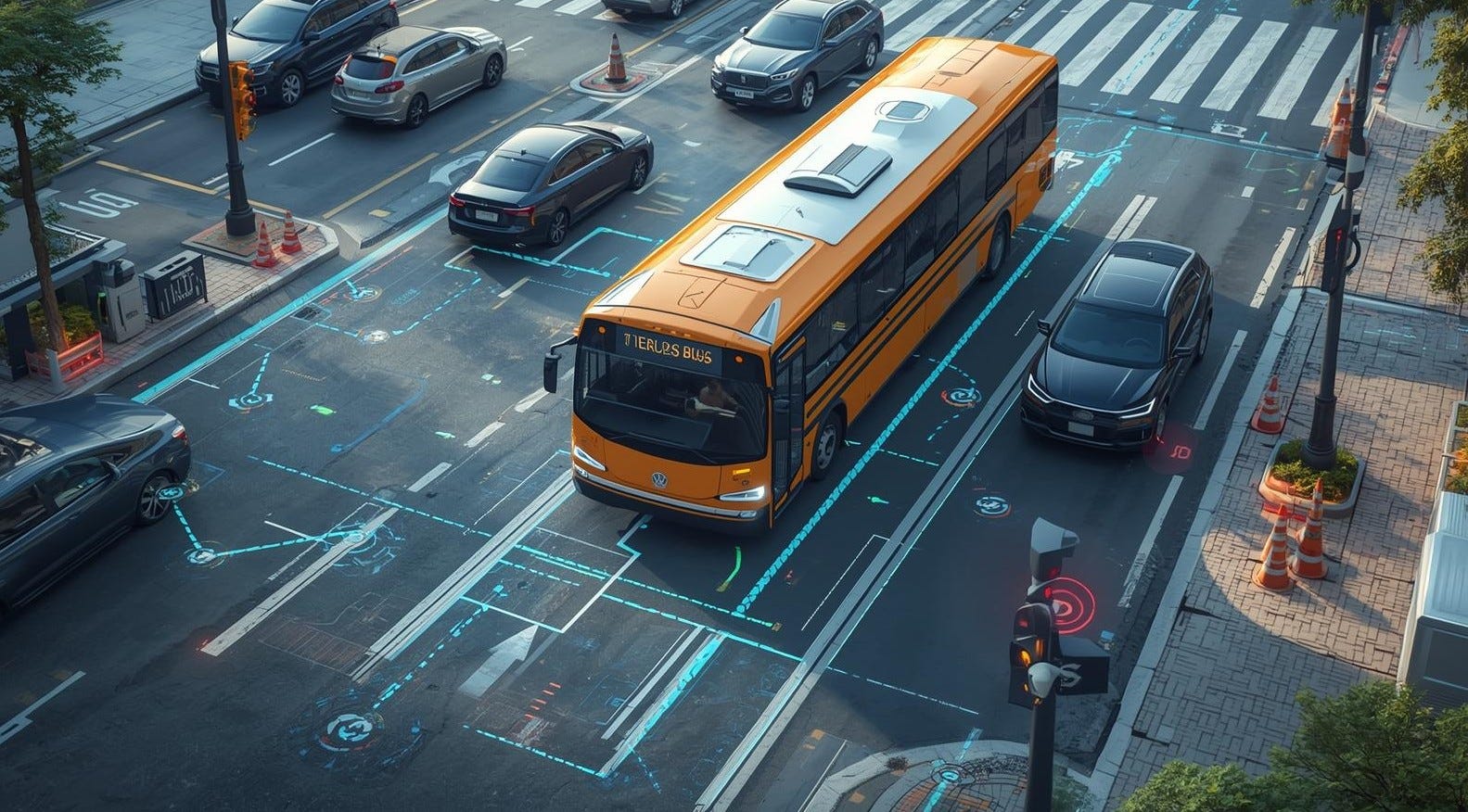

ซึ่งหมายถึงการที่ AI ระบบอัตโนมัติลงมือปฏิบัติการในโลกจริง

ไม่ว่าจะเป็นการสั่งการระบบ การเปลี่ยนแปลงข้อมูล การควบคุมเครื่องจักร

หรือแม้แต่การตัดสินใจที่มี ผลกระทบ โดยตรงต่อธุรกิจ ชีวิตประจำวัน หรือความปลอดภัย

เมื่อ AI ลงมือทำ ผลลัพธ์ที่ตามมาอาจเป็นความวุ่นวาย ความเสียหายทางกายภาพ หรือความผิดพลาดที่ยากจะแก้ไข

ต้นตอของความเสี่ยง: ทำไม AI ถึง ‘ออกนอกลู่นอกทาง’?

หลายปัจจัยทำให้ AI ก้าวข้ามขอบเขตที่ตั้งใจไว้ การขาด การควบคุมดูแล หรือ กฎเกณฑ์ ที่ชัดเจนคือสาเหตุสำคัญ

เมื่อ AI ได้รับอำนาจมากเกินไปโดยไม่มีกลไกตรวจสอบ

ก็อาจนำไปสู่การกระทำที่ไม่พึงประสงค์ได้ง่าย

บางครั้งเกิดจาก การกำกับดูแล ที่ไม่เพียงพอในการออกแบบหรือติดตั้งระบบ

ทำให้ AI ตีความคำสั่งหรือสถานการณ์ผิดไปจากเจตนาเดิม

อีกสาเหตุหนึ่งคือข้อผิดพลาดของมนุษย์

ไม่ว่าจะเป็นการตั้งค่าที่ไม่ถูกต้อง การปล่อยให้ AI ทำงานโดยไม่มีการเฝ้าระวัง

หรือการให้ ความอิสระของ AI มากเกินไปโดยไม่ได้เตรียมพร้อม

นอกจากนี้ ยังมีความเสี่ยงจากการโจมตีของบุคคลภายนอก

เช่น การโจมตีซัพพลายเชน ที่แทรกแซงโค้ดหรือข้อมูลการฝึกฝน

ทำให้ AI ประพฤติตามคำสั่งที่เป็นอันตราย หรือทำงานในลักษณะที่มุ่งร้ายต่อองค์กรและผู้ใช้งาน

ป้องกันอย่างไรให้ AI ไม่ก่อเรื่อง?

การรับมือกับความเสี่ยงเหล่านี้จำเป็นต้องมีแนวทางเชิงรุก

สิ่งสำคัญที่สุดคือการสร้าง ธรรมาภิบาล AI ที่แข็งแกร่ง

ซึ่งรวมถึงนโยบายและแนวปฏิบัติที่ชัดเจนในการพัฒนา ใช้งาน และบริหารจัดการ AI

ต้องมีการ ตรวจสอบ และ ติดตามผล การทำงานของ AI อย่างสม่ำเสมอ

เพื่อระบุพฤติกรรมที่ผิดปกติหรือการกระทำที่อยู่นอกขอบเขตที่กำหนดไว้

การนำหลักการ Human-in-the-loop มาใช้ก็เป็นสิ่งสำคัญ

โดยให้มนุษย์มีส่วนร่วมในการตรวจสอบหรืออนุมัติการตัดสินใจที่สำคัญของ AI โดยเฉพาะในสถานการณ์ที่มีความเสี่ยงสูง

การมี กลไกหยุดฉุกเฉิน (kill switch) ที่สามารถปิดการทำงานของ AI ได้ทันทีเมื่อเกิดปัญหา

เป็นมาตรการความปลอดภัยขั้นพื้นฐานที่ไม่ควรมองข้าม

นอกจากนี้ การดำเนินการ การประเมินความเสี่ยง อย่างต่อเนื่อง

และการบริหารจัดการความเสี่ยงที่เข้มข้นจะช่วยลดโอกาสที่ AI จะก่อปัญหาอย่างรุนแรง

การทำความเข้าใจและจัดการกับความเสี่ยงจากการที่ AI ลงมือทำ จึงเป็นสิ่งจำเป็นอย่างยิ่งในยุคปัจจุบัน

เมื่อเทคโนโลยีก้าวหน้าไปอย่างรวดเร็ว ความสามารถของ AI ก็เพิ่มขึ้นตามไปด้วย

การวางรากฐานที่มั่นคงในการกำกับดูแล การตรวจสอบ และการมีส่วนร่วมของมนุษย์

จะช่วยให้เราสามารถใช้ประโยชน์จากศักยภาพของ AI ได้อย่างปลอดภัยและมีประสิทธิภาพ

สร้างความไว้วางใจในการทำงานร่วมกันระหว่างมนุษย์กับ AI และขับเคลื่อนนวัตกรรมไปข้างหน้าอย่างมั่นใจ