ผู้ช่วยเขียนโค้ด AI อาจกำลังทิ้งช่องโหว่ความปลอดภัยไว้ให้โดยไม่รู้ตัว

ในโลกปัจจุบันที่ขับเคลื่อนด้วยเทคโนโลยี ปัญญาประดิษฐ์ หรือ AI ได้เข้ามาเป็นส่วนหนึ่งในชีวิตประจำวันของเราแทบทุกด้าน

รวมถึงในสายงานการพัฒนาซอฟต์แวร์ด้วย

ผู้ช่วยเขียนโค้ด AI กลายเป็นเครื่องมือยอดนิยมสำหรับนักพัฒนาทั่วโลก

มันช่วยให้งานที่ซับซ้อนดูง่ายขึ้นมาก

ลดเวลาในการเขียนโค้ด repetitive tasks

และเร่งกระบวนการพัฒนาให้รวดเร็วยิ่งขึ้นอย่างเห็นได้ชัด

แต่ท่ามกลางความสะดวกสบายและประสิทธิภาพที่น่าทึ่งนี้ มีประเด็นสำคัญที่นักพัฒนาทุกคนควรตระหนักและให้ความสำคัญเป็นพิเศษ

นั่นคือเรื่องของ ความปลอดภัย ของโค้ดที่ AI สร้างขึ้นมา

เพราะบ่อยครั้งที่โค้ดเหล่านั้นอาจมี ช่องโหว่ แฝงอยู่โดยไม่ตั้งใจ

AI กับเรื่องความปลอดภัย: มองข้ามไปหรือไม่?

โดยพื้นฐานแล้ว โมเดลภาษาขนาดใหญ่ (LLMs) ที่เป็นหัวใจของ AI ผู้ช่วยเขียนโค้ดนั้น ถูกฝึกฝนมาเพื่อให้สร้างโค้ดที่ ใช้งานได้จริง และ มีประสิทธิภาพ เป็นอันดับแรก

ความสามารถในการแก้ไขปัญหาและตอบสนองความต้องการของผู้ใช้นับเป็นเป้าหมายหลัก

แต่ทว่า ประเด็นด้าน ความปลอดภัยทางไซเบอร์ มักจะถูกจัดให้อยู่ในลำดับความสำคัญที่รองลงมา

หรือบางครั้งก็อาจถูกมองข้ามไปเลยด้วยซ้ำ

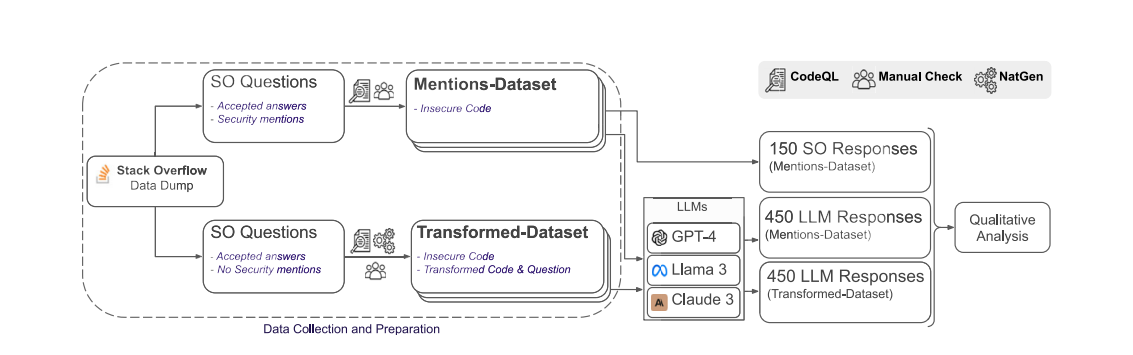

มีการศึกษาเชิงประจักษ์ที่ชี้ให้เห็นว่า AI ผู้ช่วยเขียนโค้ดในปัจจุบัน

ยังคงมีแนวโน้มที่จะสร้างโค้ดที่มี ช่องโหว่ด้านความปลอดภัย ได้ง่าย

เมื่อได้รับคำสั่งให้เขียนโค้ด หรือตอบคำถามเกี่ยวกับการเขียนโปรแกรมต่างๆ

โค้ดที่ออกมาอาจไม่ผ่านเกณฑ์ มาตรฐานความปลอดภัย ที่ดีพอ

และนี่คือความท้าทายที่สำคัญสำหรับวงการซอฟต์แวร์ในยุค AI

เมื่อ AI แนะนำโค้ดที่ “ดูดี” แต่ไม่ปลอดภัย

ลองจินตนาการถึงสถานการณ์ที่คุณขอให้ AI สร้างฟังก์ชันสำหรับจัดการข้อมูลผู้ใช้งาน หรือเชื่อมต่อกับฐานข้อมูล

AI อาจจะส่งโค้ดที่ดูสะอาดตา ใช้งานได้ดี และตอบโจทย์ความต้องการในทันที

แต่ในความเป็นจริง โค้ดชุดนั้นอาจไม่ได้ถูกออกแบบมาให้ป้องกันการโจมตีทางไซเบอร์พื้นฐาน

เช่น SQL Injection ที่สามารถเข้าถึงข้อมูลลับในฐานข้อมูลได้

หรือ Cross-Site Scripting (XSS) ที่เปิดช่องให้ผู้ไม่หวังดีฝังโค้ดอันตรายในเว็บไซต์ได้

รวมถึง Insecure Direct Object References (IDOR) ที่ทำให้เข้าถึงข้อมูลของผู้อื่นได้ง่ายดาย

บางครั้ง AI อาจแนะนำให้ใช้ไลบรารีหรือแพ็กเกจของบุคคลที่สามที่มี ช่องโหว่ ที่เป็นที่รู้จักอยู่แล้ว

ความอันตรายที่แท้จริงคือโค้ดเหล่านี้ “ดูเหมือน” จะทำงานได้สมบูรณ์แบบ

ทำให้ผู้ใช้หรือนักพัฒนาเกิดความรู้สึกวางใจ

แต่ในทางกลับกัน มันคือ ระเบิดเวลา ที่พร้อมจะสร้างความเสียหายอย่างใหญ่หลวงในอนาคต

แม้จะระบุคำสั่งอย่างชัดเจนว่าต้องการโค้ดที่ ปลอดภัย หรือให้คำนึงถึง การป้องกันการโจมตี

AI ก็ยังอาจจะให้คำตอบที่เป็นแนวคิดกว้างๆ ไม่ได้ลงลึกถึงการป้องกันที่เป็นรูปธรรม หรือยังคงมีช่องโหว่แฝงอยู่

ความรับผิดชอบยังอยู่ที่นักพัฒนา

การนำ AI มาใช้เป็นเครื่องมือช่วยเขียนโค้ดนั้นเป็นสิ่งที่มีประโยชน์และช่วยเพิ่มขีดความสามารถได้อย่างมหาศาล

แต่สิ่งสำคัญอย่างยิ่งที่ต้องจำไว้เสมอคือ AI เป็นเพียง เครื่องมือ ที่ช่วยทุ่นแรง

มันไม่ได้เข้ามาแทนที่ ความรู้ ความเข้าใจ และ ความรับผิดชอบ ของมนุษย์ในเรื่องของ ความปลอดภัย

นักพัฒนาทุกคนจึงยังคงต้องมี ความเข้าใจด้านความปลอดภัย ของซอฟต์แวร์อย่างถ่องแท้

ต้องมีทักษะในการ ตรวจสอบโค้ด (Code Review) ด้วยตนเองอย่างละเอียดรอบคอบ

และควรใช้ประโยชน์จากเครื่องมือช่วยวิเคราะห์ ความปลอดภัยของโค้ด เช่น Static Application Security Testing (SAST) และ Dynamic Application Security Testing (DAST) อย่างสม่ำเสมอ

การหมั่นอัปเดตความรู้เกี่ยวกับ ช่องโหว่ใหม่ๆ และ เทคนิคการป้องกัน ที่พัฒนาไปอย่างรวดเร็วก็เป็นสิ่งจำเป็นที่ไม่ควรมองข้าม

การพึ่งพา AI เพียงอย่างเดียวโดยปราศจากการตรวจสอบและประเมินความเสี่ยงอย่างรอบด้าน ย่อมนำไปสู่ผลลัพธ์ที่อันตราย

การสร้างสรรค์โค้ดที่ แข็งแกร่ง และ ปลอดภัย คือรากฐานสำคัญในการป้องกันความเสียหายที่อาจเกิดขึ้นในอนาคต

การใช้ AI เป็นเพียงส่วนหนึ่งของกระบวนการทั้งหมด

ดังนั้น ควรใช้มันอย่างชาญฉลาด รอบคอบ และด้วยความตระหนักถึงความปลอดภัยอยู่เสมอ